1月7日9时5分,西藏定日县发生6.8级地震,灾情牵动人心,许多网友在社交平台上为灾民祈福。

但与此同时,一些疑似虚假信息,比如AI制造的图片,正在造成广泛误导。

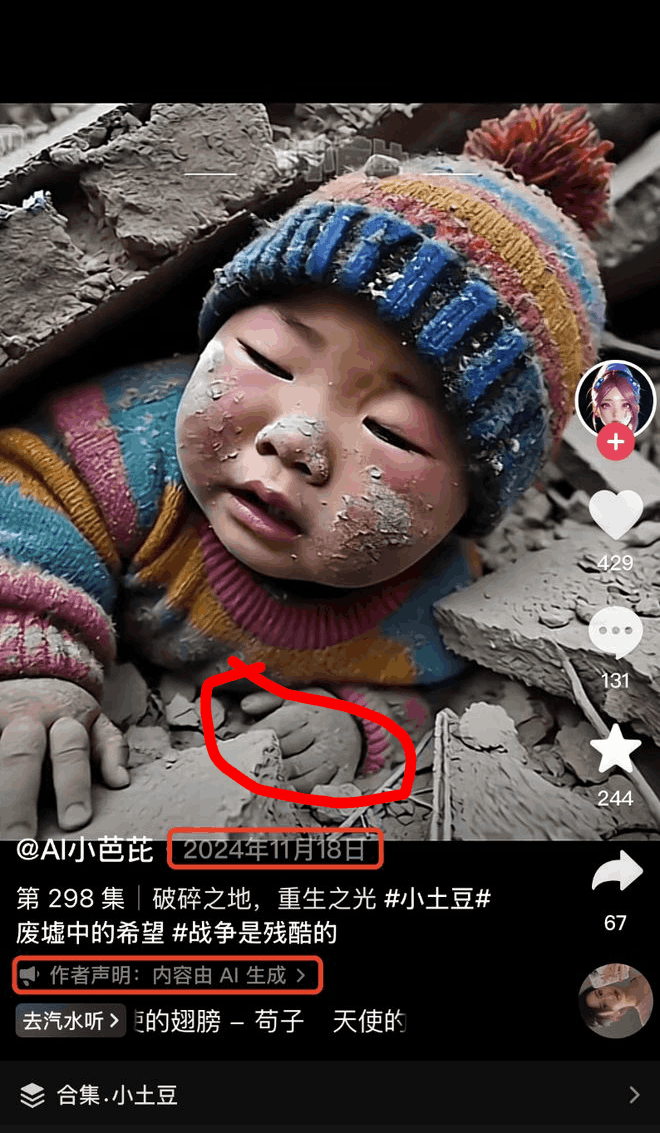

比如下面这张图片:一个戴帽子的小孩被重压在倒塌的建筑物下,在某短视频平台上,至少有10个以上的账号发布,并和西藏日喀则地震关联,有些甚至获得好几万的转评赞。

许多网友看到图片后,为图中的孩子难受落泪,甚至都在追问,这个图片中的小孩怎么样了,并未留意到可能的疑点。

经查证,上述图片由AI工具创作,原始作者在2024年11月18日发布了相同画面的短视频,并声明是AI生成。仔细观察图片红圈的部分,也可以看到这个小孩的左手有6根手指。

不光是这张图片,还有一些标着“日喀则地震”的图片也并非是现场图。比如这张“在废墟中妈妈用身体为孩子顶住压力”的图片,评论区还有人说“目前已经救出,其母亲多处骨折还是平安无事”,对于不明真相的路人很容易相信确有其事,但只要截图后选择“识别图片”,就能在同平台上看到2022年就有创作者发布,当时还是“一张照片一个感人故事”,明显是借由AI或旧图重新拼接,故意混淆视听。

提醒:AI生成的虚假灾情图片可能会影响救灾资源分配,转发时需慎重甄别。

如何识别 AI 造假内容?

制作不够精良的AI造假视频、图文用肉眼就可看出异常。例如,人物表情僵硬、面部边缘模糊、背景的过渡不自然、人脸的光影效果与周围环境的光线情况不符、手指扭曲或手指数量不对等。但是,随着技术的进步,这些异常特征越来越少,肉眼分辨也会越来越难。

这种情况下必须通过技术检测、法律监管、公众教育和平台审查等方法来防范AI技术的滥用,尤其公众,一定要认识到AI造假的危险性,并提高警惕。比如,去信任那些权威机构或有权威机构背书、声誉一贯良好、出错也能自己纠错的信源;对于任何来源可疑的内容,我们都要保持合理的怀疑,尤其是打算根据这些信息采取进一步行动的时候。

面对灾情,我们能理解社会公众心系灾区,为受灾群众担忧的心情。但我们也需要警惕某些不怀好意的人利用社会公众的这种心情,通过AI技术伪造内容,骗取同情,套取流量,甚至做出更出格的、有违公序良俗的事情。

大灾面前有大爱。廓清真相,明辨真伪,避免受到假图片、假信息的误导,让谣言无所遁形,才能让大爱更顺畅地传递!

(羊城晚报•羊城派综合自新京报、科普中国、网友评论)